AI memvonis AI

Seorang dosen di Solo pernah cerita ke saya, suaranya pelan tapi getir. Ia baru saja menggagalkan tugas akhir seorang mahasiswanya. Bukan karena isinya jelek. Justru karena terlalu rapi. AI detector di kampusnya menunjukkan angka 87 persen, dan angka itu, kata si dosen, sudah cukup untuk dijadikan dasar.

Mahasiswa itu menangis di ruangannya. Ia bersumpah menulis sendiri. Ia bahkan menunjukkan riwayat dokumen di Google Docs, jejak revisi yang ratusan kali, catatan tangan di buku tulis. Tapi si dosen menggeleng. Mesin sudah berbicara.

Saya membayangkan mahasiswa itu pulang naik motor, lewat Slamet Riyadi yang gerimis, memikirkan bahwa setahun kerjanya dibatalkan oleh sebuah angka yang ia tidak pernah tahu bagaimana cara hitungnya.

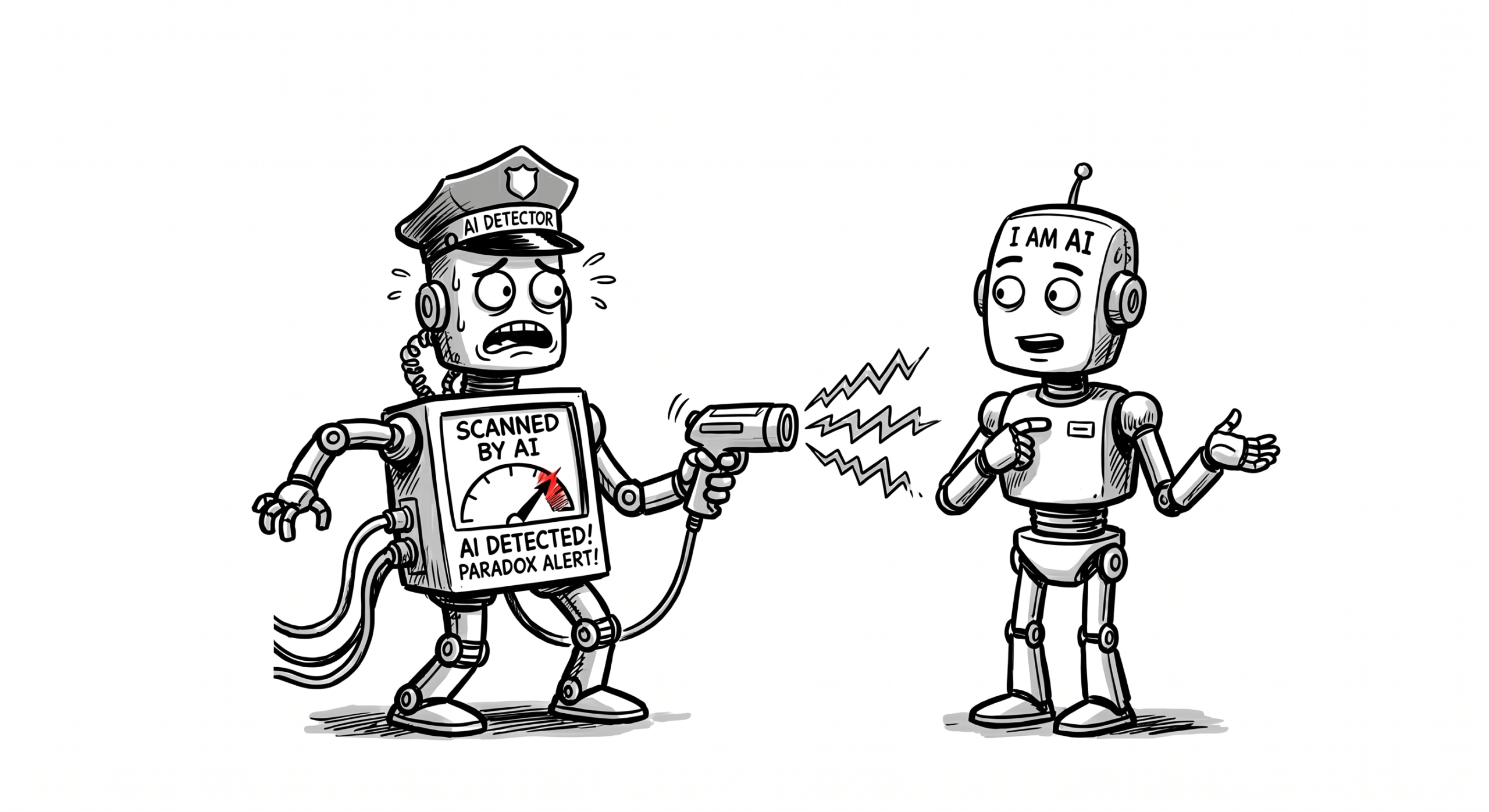

Di situ saya mulai berpikir. Ketika seseorang memakai AI detector untuk memeriksa tulisan yang dicurigai dibuat AI, ia sebenarnya sedang memakai AI untuk menghakimi AI. Detector itu sendiri model machine learning. Sebuah mesin statistik yang dilatih mengenali pola. Kita menyerahkan keputusan ke mesin, lalu memperlakukan hasilnya seolah itu putusan hakim agung.

Dan masalahnya lebih dalam lagi.

Detector bekerja dengan probabilitas, bukan kepastian. Di dalam mesin itu tidak ada pemahaman. Yang ada cuma angka. Tujuh puluh tiga persen kemungkinan AI, dua puluh tujuh persen kemungkinan manusia. Angka semacam ini menciptakan ilusi presisi yang berbahaya. Di baliknya ada false positive (manusia yang dituduh mesin) dan false negative (mesin yang lolos disangka manusia). Beberapa penelitian bahkan menunjukkan, tulisan dari penutur non-native lebih sering dicap AI karena struktur kalimat mereka cenderung lebih rapi, kurang idiomatik, kurang berantakan dibanding penulis native. Ironi yang menyakitkan. Mereka yang paling keras berusaha menulis dengan benar justru paling rentan dituduh curang.

Yang lebih lucu, standar “terasa seperti AI” itu sendiri terus bergeser. Tulisan yang dianggap AI tahun lalu bukan standar yang sama tahun depan. Kita sebenarnya hanya sedang mendefinisikan kecurigaan berdasarkan kebiasaan satu generasi model tertentu. Pola yang hari ini dianggap khas mesin, besok bisa berubah total karena ada model baru yang lebih canggih. Lalu sebenarnya kita mendeteksi apa? AI, atau bayangan kita sendiri tentang AI?

Untuk memahami problem ini lebih jernih, izinkan saya mundur beberapa ribu tahun.

Plato dalam dialognya yang berjudul Phaedrus pernah membuat Socrates marah-marah soal tulisan. Bukan soal AI tentu saja. Socrates marah pada tulisan itu sendiri. Menurutnya, tulisan melemahkan ingatan dan menciptakan ilusi pengetahuan. Seseorang membaca teks, merasa tahu, padahal yang ia pegang cuma bayangan dari pemikiran yang hidup. Tulisan adalah pharmakon, racun sekaligus obat. Ia membantu sekaligus menipu.

Kalau Socrates hidup sekarang, mungkin ia akan tertawa pahit melihat AI detector. Sebab detector berada di posisi yang jauh lebih paradoksal. Ia bukan sekadar alat baca seperti yang dikhawatirkan Socrates. Ia alat yang menghakimi teks. Dan instrumen penghakiman ini sama sekali tidak punya pemahaman. Ia bekerja dengan korelasi statistik. Bukan dengan membaca makna. Ia tidak tahu apakah argumen di teks itu benar, apakah data yang dikutip valid, apakah penalarannya jujur. Ia cuma tahu satu hal. Pola distribusi kata di sini mirip pola yang pernah ia lihat dari mesin lain.

Bayangkan dokter yang mendiagnosis pasien dengan cara menimbang berat badannya saja. Tidak periksa darah, tidak cek paru-paru, tidak baca riwayat. Cuma timbang. Lalu memberi vonis. Itu kira-kira yang sedang dilakukan AI detector.

Saya teringat Heidegger di sini. Dalam Being and Time, ia membedakan keberadaan yang autentik dan yang tidak autentik. Yang tidak autentik adalah orang yang larut dalam das Man, dalam orang-orang pada umumnya. Bicara dengan bahasa yang sudah jadi, berpikir dengan kategori yang dipinjam, tanpa pernah benar-benar mengambil posisi sendiri.

Pertanyaan filosofisnya, apakah tulisan AI selalu tidak autentik dalam pengertian Heidegger?

Belum tentu. Saya kenal seorang dosen muda yang menulis sendiri seluruh disertasinya. Ratusan halaman. Tidak pakai AI sedikit pun. Tapi kalau Anda ajak ia diskusi tiga puluh menit, Anda akan tahu ia tidak benar-benar mengerti apa yang ia tulis. Ia mengulang kalimat-kalimat yang sudah ia hafal, tanpa bisa merespons pertanyaan yang sedikit menyimpang dari script. Di sisi lain, saya kenal mahasiswa yang menggunakan AI sebagai mitra berpikir, lalu menyaring, mempertanyakan, menyusun ulang. Hasilnya, ia bisa membela tulisannya berjam-jam karena setiap kalimat sudah ia gulati.

Mana yang lebih autentik?

Otentisitas bukan soal asal-usul kata, melainkan soal apakah pikiran itu benar-benar diambil alih, dipertanggungjawabkan dan dijadikan milik. Detector tidak membaca proses. Ia cuma membaca produk akhir. Dan produk akhir yang sama bisa lahir dari dua proses yang secara etis sangat berbeda.

Roland Barthes pada 1967 menulis esai The Death of the Author. Argumennya, begitu teks selesai ditulis, ia lepas dari niat pengarangnya. Makna bukan milik orang yang menulis, makna lahir dari pertemuan teks dengan pembaca. Kalau kita ikuti Barthes secara radikal, pertanyaan ditulis-manusia-atau-AI menjadi tidak terlalu menarik dibanding pertanyaan apakah teks ini bekerja, apakah argumennya valid, apakah ia menggerakkan pikiran.

Saya tergoda mengikuti Barthes. Tapi ada tegangan yang tidak bisa saya abaikan.

Barthes berbicara dalam konteks sastra. Dalam konteks akademik atau jurnalistik, kepengarangan masih punya beban etis yang nyata. Seseorang yang mengklaim menulis disertasi sendiri lalu ternyata menyerahkannya ke AI tidak sedang melakukan interpretasi kreatif. Ia sedang berbohong. Bukan karena teksnya buruk, melainkan karena ada janji yang dilanggar. Janji bahwa karya ini adalah hasil pergulatan intelektualnya sendiri.

Jadi bukan sekadar siapa yang menulis dalam pengertian metafisik. Pertanyaannya adalah siapa yang bertanggung jawab dalam pengertian sosial dan etis. Dan tanggung jawab tidak bisa dideteksi algoritma.

Foucault menganalisis bagaimana institusi menciptakan rezim kebenaran. Sebuah sistem yang menentukan apa yang dianggap sah, apa yang dianggap pelanggaran, siapa yang berwenang memutuskan.

AI detector kini mendefinisikan standar tulisan yang sah versi dia sendiri. Teks yang terlalu rapi dicurigai. Dan inilah ironinya. Tulisan mahasiswa yang belajar keras, yang kalimatnya mulai terstruktur, yang argumennya mulai koheren, justru paling rentan dituduh AI.

Kita sedang membangun sistem yang menghukum kompetensi. Normalisasi kegagalan, di mana ketidaksempurnaan justru menjadi bukti keaslian.

Ada satu pertanyaan lagi. Ketika kita bilang sebuah tulisan terasa seperti AI, kita sebenarnya merujuk ke standar apa? Standar itu dibentuk dari korpus tulisan manusia masa lalu. Tapi manusia itu sendiri berubah. Kita sudah membaca ribuan teks AI. Sudah terpapar polanya. Tanpa sadar, kita mulai menulis dengan polanya, mengadopsi ritmenya, meminjam strukturnya.

Makna dari sebuah kata tidak tetap. Ia hidup dalam penggunaan, dan penggunaan itu terus berubah. Tulisan autentik adalah konsep yang sedang kita negosiasikan ulang. Bukan sesuatu yang sudah jelas dari sananya.

Lalu, ke mana kita menuju?

Saya mengusulkan satu jalan yang sebenarnya bukan ide baru. Untuk meyakinkan bahwa seseorang benar-benar memahami apa yang ia tulis, ujilah dengan pertanyaan. Dengan dialog. Dengan percakapan yang memungkinkan ia menunjukkan apakah ada jejak kognitif yang tertinggal dari proses menulisnya.

Socrates sudah melakukan ini ribuan tahun lalu. Ia mendatangi orang-orang yang mengklaim tahu sesuatu, lalu bertanya. Bertanya terus. Bertanya sampai mereka sendiri sadar bahwa mereka tidak benar-benar mengerti. Para pengrajin tahu cara membuat sepatu tapi tidak bisa menjelaskan kenapa sepatu itu baik. Para penyair menulis puisi indah tapi tidak bisa menjelaskan dari mana ilhamnya datang. Socrates menyebut metode ini elenchus. Pengujian melalui pertanyaan. Kesimpulannya orang-orang itu bukan penipu. Kesimpulannya, mereka tidak tahu bahwa mereka tidak tahu.

Ada sesuatu yang memang tidak bisa didelegasikan ke AI. Yaitu pengalaman berpikir itu sendiri. Kalau seseorang benar-benar melewati proses menulis, ada jejak yang tertinggal. Ia bisa berkata, saya sempat ragu di bagian ini karena begini. Atau, saya pilih argumen ini dan buang yang itu karena begitu. Atau, waktu saya tulis paragraf tiga, saya belum yakin dengan kesimpulannya. Jejak keraguan semacam itu sulit dipalsukan secara spontan.

Tapi saya tidak mau ngotot dengan usulan ini, setidaknya dengan beberapa pertimbangan.

Pertama, ada yang disebut transfer of understanding. Seseorang bisa membaca teks AI, memahaminya sungguh-sungguh, menjadikannya bagian dari pikirannya, lalu mampu menjelaskannya dengan baik. Apakah ia curang? Wilayah ini abu-abu, dan tidak nyaman. Kita semua belajar dari sumber luar. Batas antara belajar dari AI dan menyuruh AI bekerja untukmu tidak setajam yang kita bayangkan.

Kedua, kemampuan verbal dan kemampuan menulis adalah dua hal yang berbeda. Ada orang yang pikirannya tajam tapi grogi ketika diuji lisan. Ada yang menulis dengan jernih tapi bicaranya berantakan. Kalau kita menjadikan kemampuan menjawab pertanyaan lisan sebagai bukti utama, kita sedang mendiskriminasi gaya berpikir tertentu.

Ketiga, ini yang paling mengganggu. Pengujian lisan juga bisa dilatih. Seseorang bisa membaca teks AI, mempelajarinya, melatih jawaban untuk pertanyaan yang mungkin muncul, lalu lolos. Itu bukan pemahaman. Itu kemampuan melewati ujian. Sistem pendidikan kita sudah terlalu akrab dengan fenomena ini. Siswa yang pintar ujian tapi kosong pemahaman.

Usulan pengujian lisan sebenarnya menggeser pertanyaan dari siapa yang menulis, ke siapa yang memahami. Pergeseran ini baik. Bermartabat. Tapi ada konsekuensinya.

Kalau pemahaman menjadi kriteria utama, maka proses penulisan menjadi tidak relevan. Yang penting bukan bagaimana teks itu lahir, melainkan apakah orang yang mengklaimnya benar-benar menguasai isinya. Kalau begitu, kita harus konsisten. Seseorang yang menulis sendiri tapi tidak paham apa yang ia tulis juga harus dianggap gagal, meskipun ia tidak pakai AI sama sekali.

Dan mari jujur. Banyak tulisan akademik yang persis seperti itu. Ditulis manusia, tidak dipahami penulisnya. Dihasilkan dengan susah payah, kosong dari pemahaman.

Selama kita mencari jawabannya di alat, kita menghindari pertanyaan yang lebih penting. Apa sebenarnya yang kita minta dari seseorang ketika kita minta ia menulis sendiri? Kita minta produk, atau kita minta proses? Kita minta kata-katanya, atau kita minta pikirannya?

Tapi setidaknya pengujian lisan lebih bermartabat daripada detector karena ia memperlakukan orang sebagai subjek yang bisa diajak berdialog. Bukan sebagai teks yang dianalisis secara statistik. Ia menghormati kompleksitas manusia, ruang untuk keraguan, kemungkinan untuk menjelaskan. Tapi ia juga bukan solusi tuntas.

Yang lebih mendasar, kita perlu memutuskan tujuan sebenarnya dari praktik menulis. Kalau tujuannya menghasilkan teks yang baik, AI sudah menang dan pertarungan ini sia-sia. Kalau tujuannya melatih proses berpikir, maka yang perlu diubah bukan cara kita mendeteksi kecurangan. Yang perlu diubah adalah cara kita merancang tugas sejak awal. Tugas yang tidak bisa diselesaikan AI, bukan karena AI dilarang, melainkan karena tugasnya memang menuntut sesuatu yang hanya bisa datang dari pengalaman hidup spesifik si penulis. Dari posisi subjektifnya. Dari pergulatan pribadinya. Dari sudut pandang yang tidak bisa direplikasi mesin statistik mana pun.

Saya teringat mahasiswa yang menangis di ruangan dosennya di Solo itu. Ia tidak akan pernah tahu, di sisa hidupnya, apakah ia pernah benar-benar didengar atau tidak. Yang ia tahu cuma satu, sebuah mesin memberinya angka, dan angka itu lebih dipercaya daripada air matanya.